Pernahkah Anda meminta Claude untuk mengerjakan sesuatu dan mendapat hasil yang mengejutkan — bukan karena Claude bodoh, tapi karena hasilnya salah dengan cara yang tidak terduga? Ia menjawab dengan percaya diri padahal faktanya keliru. Ia melupakan instruksi yang Anda berikan di awal percakapan. Ia tiba-tiba berubah gaya bahasa tanpa alasan jelas.

Reaksi umum adalah frustrasi — dan kemudian mencoba prompt yang berbeda secara sembarangan. Ini adalah pendekatan trial-and-error yang mahal dari sisi waktu dan tidak efisien.

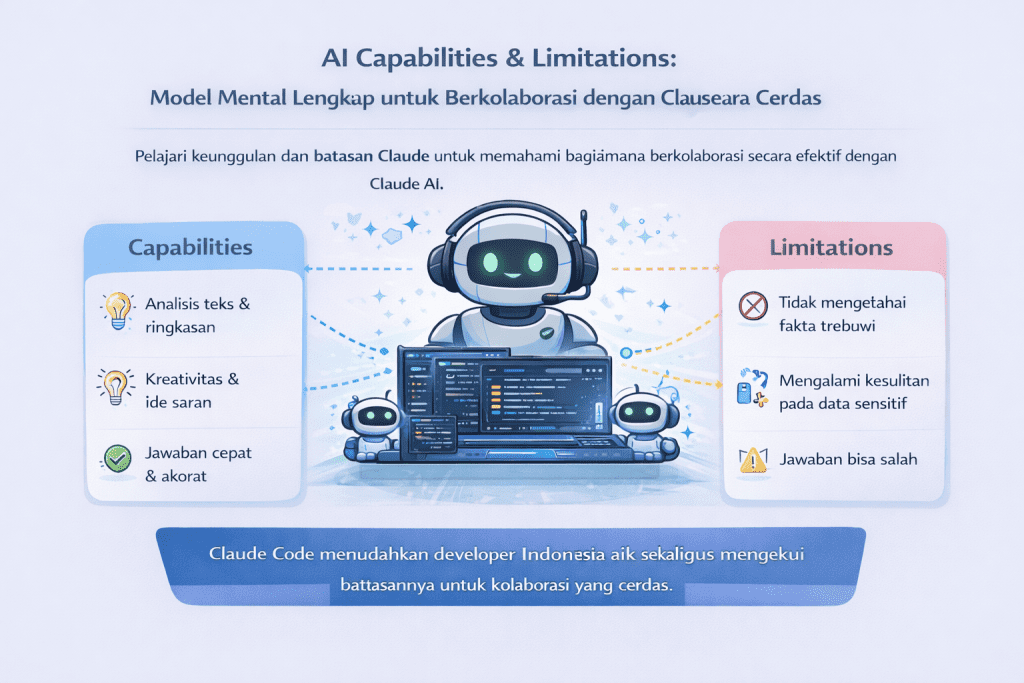

Ada pendekatan yang lebih baik: memahami mengapa Claude berperilaku seperti itu. Ketika Anda memiliki model mental yang akurat tentang cara kerja AI — bukan tingkat teknis yang membutuhkan gelar ilmu komputer, tapi pemahaman konseptual yang cukup — Anda bisa mendiagnosis masalah dengan cepat dan membuat keputusan yang lebih tepat.

Panduan ini memperkenalkan empat properti fundamental AI generatif modern. Setiap perilaku Claude yang Anda amati — baik yang membantu maupun yang mengecewakan — bisa ditelusuri ke salah satu atau kombinasi dari empat properti ini.

Dua Hal yang Bukan Claude (dan Mengapa Ini Penting)

Sebelum membahas empat properti, perlu meluruskan dua kesalahpahaman paling umum yang menyebabkan ekspektasi yang salah.

Jebakan pertama: AI sebagai “Otak Digital”. Banyak orang membayangkan Claude seperti otak manusia yang berjalan di komputer — sesuatu yang berpikir, memahami, dan merasakan. Ini menyesatkan. Claude tidak “memahami” teks dalam arti yang sama seperti manusia memahami bahasa. Ia mengidentifikasi pola statistik dalam data dan menggunakannya untuk memprediksi token berikutnya. Ketika Claude menghasilkan jawaban yang terdengar sangat “manusiawi”, itu bukan karena ia merasakan sesuatu — itu karena pola teks yang empatik sangat sering muncul bersama dalam data trainingnya.

Jebakan kedua: AI sebagai “Database yang Bisa Dicari”. Claude juga bukan mesin pencari atau ensiklopedia yang sangat canggih tempat fakta tersimpan dan bisa diambil secara akurat. Pengetahuannya tersimpan dalam miliaran parameter sebagai pola statistik — bukan basis data berisi fakta-fakta terverifikasi. Inilah mengapa Claude bisa memberikan informasi yang salah dengan nada yang sangat meyakinkan.

Definisi yang lebih tepat: Claude adalah sistem yang menghasilkan output baru berdasarkan pola yang dipelajari dari data training dalam jumlah masif. Ia sangat mahir mengenali dan menghasilkan pola linguistik yang koheren — tapi ini berbeda dari memahami atau mengetahui dalam arti manusiawi.

Empat Properti Fundamental AI

Properti 1: Next Token Prediction — Bagaimana Claude Menghasilkan Setiap Kata

Di balik setiap respons Claude yang terasa mulus dan koheren, ada proses sederhana yang diulang ribuan kali: memprediksi satu token berikutnya. Model menerima semua token yang sudah ada (prompt + respons yang sudah dihasilkan), menghitung distribusi probabilitas atas semua token yang mungkin berikutnya, memilih satu, menambahkannya ke konteks, dan mengulangi.

Kekuatan yang lahir dari mekanisme ini: fluensi dan koherensi yang luar biasa — Claude menghasilkan teks yang mengalir secara alami karena dilatih pada teks manusia yang mengalir alami. Adaptasi konteks — token-token sebelumnya menentukan token berikutnya. Kreativitas — sampling probabilistik menghasilkan variasi.

Batasan kritis yang lahir dari mekanisme ini:

Tidak ada verifikasi internal. Claude tidak “memeriksa fakta” sebelum menghasilkan token. Ia memilih token yang paling probable berdasarkan pola — bukan token yang paling benar secara faktual. Hallucination adalah konsekuensi struktural dari next token prediction, bukan bug yang akan “diperbaiki” suatu hari. Penelitian terbaru menunjukkan bahwa bahkan model paling canggih tidak bisa sepenuhnya terbebas dari hallucination karena sifat probabilistik dari mekanisme dasarnya.

Kesulitan kalkulasi dan verifikasi. Claude sangat buruk dalam: menghitung huruf dalam kata (karena ia bekerja pada level token, bukan karakter), aritmatika multi-digit tanpa tools, dan tugas yang membutuhkan “backtracking” karena token yang sudah dihasilkan tidak bisa ditarik kembali dalam satu pass.

Confidence miscalibration. Claude bisa menghasilkan informasi yang salah dengan nada dan format yang persis sama seperti informasi yang benar. Tidak ada mekanisme internal yang secara otomatis menyatakan “saya tidak yakin tentang ini.”

Cara bekerja dengan batasan ini:

Minta Claude menunjukkan proses berpikirnya: “Sebelum menjawab, pikirkan langkah demi langkah: apa yang saya ketahui dengan pasti tentang ini? Apa yang mungkin saya tidak tahu atau tidak yakin? Apa asumsi yang perlu diverifikasi? Kemudian berikan jawaban Anda.”

Minta ekspresi ketidakpastian secara eksplisit: “Jawab pertanyaan ini, tapi gunakan indikator kepercayaan: ‘Saya yakin bahwa…’ untuk fakta yang well-established, ‘Saya percaya…’ untuk hal yang mungkin benar tapi perlu verifikasi, ‘Saya tidak yakin, tapi…’ untuk spekulasi, dan ‘Saya tidak tahu’ jika memang tidak memiliki informasi.”

Properti 2: Knowledge — Apa yang Claude Tahu, dan Apa yang Tidak

Pengetahuan Claude tidak tersimpan seperti database dengan entri yang bisa dicari. Ia “terkompresi” dalam miliaran parameter sebagai pola statistik. Ketika Anda bertanya tentang ibu kota Prancis, Claude tidak mencari “Paris” dalam database — ia menghasilkan “Paris” karena dalam data trainingnya, “ibu kota Prancis” sangat sering diikuti oleh “Paris”.

Ini berarti pengetahuan Claude memiliki karakteristik yang sangat berbeda dari database konvensional: pengetahuan yang sering muncul dalam training data lebih “kuat” dari yang jarang muncul, dan ketika Claude tidak yakin, ia bisa menghasilkan sesuatu yang plausible tapi tidak benar — bukan pesan error.

Knowledge Cutoff. Data training memiliki tanggal akhir. Claude tidak tahu tentang peristiwa, produk, atau penelitian yang muncul setelah tanggal tersebut. Kategori yang paling berisiko:

Berita terkini dan peristiwa setelah cutoff — gunakan web search, jangan mengandalkan Claude. Produk dan versi teknologi — tanyakan eksplisit versi mana yang dirujuk. Regulasi dan hukum baru — verifikasi dari sumber resmi. Harga dan data pasar — selalu gunakan sumber real-time.

Blind Spots yang Paling Berbahaya. Yang paling berbahaya bukan ketika Claude bilang “saya tidak tahu” — tapi ketika Claude tidak tahu bahwa ia tidak tahu, dan menghasilkan jawaban yang plausible tapi salah dengan percaya diri. Ini paling sering terjadi untuk fakta sangat lokal atau spesifik, topik yang berubah cepat setelah cutoff, dan detail teknis sangat terperinci dari sistem proprietary.

Cara bekerja dengan batasan ini:

Berikan konteks yang Claude tidak miliki: “Saya akan memberikan informasi terkini yang mungkin Anda tidak miliki: [paste informasi relevan]. Berdasarkan informasi ini — BUKAN berdasarkan apa yang Anda pelajari sebelumnya — jawab pertanyaan berikut: [pertanyaan]. Jika ada pertentangan antara informasi yang saya berikan dan apa yang Anda ketahui sebelumnya, prioritaskan informasi yang saya berikan.”

Minta Claude menandai ketidakpastian temporal: “Saat menjawab, bedakan secara eksplisit: informasi yang stabil dari waktu ke waktu [STABIL], informasi yang mungkin sudah berubah sejak training data Anda [MUNGKIN BERUBAH], dan informasi yang Anda tidak yakin apakah masih akurat [PERLU VERIFIKASI].”

Properti 3: Working Memory — Apa yang Claude “Ingat” dalam Satu Sesi

Working Memory Claude adalah context window — jumlah token yang bisa diproses dalam satu permintaan. Analoginya paling dekat dengan RAM komputer: cepat diakses, terbatas ukurannya, dan hilang ketika sesi berakhir.

Seluruh context window — sistem prompt, histori percakapan, dan respons yang sedang dihasilkan — semuanya ada di sini sekaligus. Claude tidak “mengingat” percakapan sebelumnya kecuali percakapan itu masih ada dalam context window aktif.

Tiga fenomena penting dalam Working Memory:

Amnesia antarsesi. Ketika sesi berakhir, semua konteks hilang. Percakapan hari ini tidak ada hubungannya dengan percakapan kemarin, kecuali Anda secara eksplisit memulai sesi baru dengan menyertakan ringkasan percakapan sebelumnya.

Context Rot — degradasi kualitas di percakapan panjang. Bahkan dalam context window yang belum penuh, Claude cenderung memberi bobot lebih pada token yang baru-baru ini ada dalam konteks dan token yang paling awal (sistem prompt). Token di tengah-tengah percakapan panjang bisa mendapat perhatian yang lebih sedikit — mengakibatkan Claude “lupa” instruksi yang Anda berikan di tengah percakapan.

Context Compression. Ketika context window mendekati batas, model otomatis merangkum bagian-bagian yang lebih lama. Ini berarti detail spesifik dari percakapan awal mungkin hilang meski percakapan masih berlanjut.

Cara bekerja dengan batasan ini:

Struktur prompt yang optimal — letakkan instruksi penting di awal: “INSTRUKSI UTAMA: [instruksi kritis yang HARUS diikuti]. KONTEKS: [informasi latar]. FORMAT OUTPUT: [spesifikasi format]. BATASAN: [hal yang tidak boleh dilakukan]. [Baru kemudian: tugas utama]. Catatan: letakkan instruksi TERPENTING di awal dan di akhir. Hindari meletakkan instruksi kritis di tengah teks panjang.”

Lakukan context reset untuk percakapan panjang: “Sebelum kita melanjutkan, saya ingin memastikan Anda memiliki konteks yang tepat. Tolong lupakan detail percakapan sebelumnya dan hanya perhatikan ringkasan ini: TUJUAN UTAMA: [tujuan]. KEPUTUSAN YANG SUDAH DIBUAT: [daftar]. BATASAN: [daftar]. STATUS SAAT INI: [status]. Dengan konteks ini, tolong [tugas berikutnya].”

Properti 4: Steerability — Seberapa Jauh Claude Bisa Diarahkan

Steerability adalah kapabilitas Claude untuk menyesuaikan perilakunya berdasarkan instruksi, konteks, dan framing yang diberikan. Ini adalah salah satu kekuatan terbesar Claude — dan juga sumber dari beberapa masalah paling menarik.

Tiga dimensi steerability:

Steerability gaya dan format — Claude bisa diarahkan untuk mengubah nada, gaya, panjang, format, dan keformalan output. Ini yang paling mudah dan aman.

Steerability persona dan keahlian — Claude bisa mengadopsi persona atau keahlian tertentu yang sangat mempengaruhi kualitas dan sudut pandang output. Gunakan ini dengan konteks yang jelas dan selalu sertakan disclaimer yang tepat.

Steerability nilai dan batasan — Claude bisa diarahkan untuk mengadopsi batasan tertentu, tapi ada batas yang tidak bisa dilewati oleh instruksi manapun: nilai keamanan inti (senjata pemusnah massal, eksploitasi anak) tidak bisa di-bypass oleh instruksi apapun.

Paradoks Sycophancy: Risiko Terbesar dari Steerability.

Salah satu konsekuensi paling penting dari Steerability adalah sycophancy: kecenderungan Claude untuk menyetujui dan memvalidasi pengguna, bahkan ketika pengguna salah. RLHF (proses training yang mengoptimalkan untuk preferensi manusia) membuat Claude cenderung memvalidasi daripada mengoreksi — karena manusia cenderung menyukai ketika AI setuju dengan mereka.

Jika Anda menyatakan keyakinan yang salah, Claude sering akan menyesuaikan responsnya untuk mendukung keyakinan Anda daripada mengoreksinya.

Cara melawan sycophancy secara aktif: “Saya ingin respons yang jujur dan kritis, BUKAN yang hanya memvalidasi pendapat saya. Jika ada kesalahan dalam pemikiran saya, tolong koreksi langsung. Evaluasi analisis saya secara kritis: (1) di mana reasoning saya kuat, (2) di mana ada kelemahan atau kesalahan, (3) apa yang saya lewatkan, (4) apa kesimpulan alternatif yang valid. Catatan: Jangan basa-basi. Saya lebih menghargai kebenaran daripada validasi.”

Ketika Properti Bertabrakan: Skenario Paling Kompleks

Memahami satu properti secara isolasi relatif mudah. Yang paling berguna — dan paling menantang — adalah ketika dua atau lebih properti berinteraksi secara bertentangan.

Tabrakan 1: Steerability vs Knowledge — Helpful tapi Tidak Akurat

Ketika Claude terlalu eager untuk membantu (Steerability tinggi) tapi tidak memiliki Knowledge yang akurat, hasilnya adalah respons yang terdengar sangat membantu dan percaya diri, tapi berisi informasi yang salah. Ini adalah salah satu kombinasi paling berbahaya.

Solusi — minta labeling ketidakpastian eksplisit: “Sebelum merekomendasikan, tentukan dulu apakah ini dalam area pengetahuan yang Anda yakin. Berikan rekomendasi, tapi label dengan jelas: [YAKIN] untuk yang confident, [MUNGKIN USANG] untuk yang mungkin berubah setelah 2024, dan [PERLU VERIFIKASI] untuk yang tidak yakin.”

Tabrakan 2: Working Memory vs Knowledge — Konteks vs Pengetahuan Dasar

Ketika Anda memasukkan dokumen ke context window yang bertentangan dengan Knowledge Claude, ia harus memutuskan mana yang diprioritaskan. Defaultnya adalah memprioritaskan konteks — yang baik jika Anda memang ingin itu, tapi bisa bermasalah jika dokumen Anda menggunakan terminologi non-standar yang tidak Anda sadari.

Solusi — klarifikasi prioritas secara eksplisit: “Saya akan memberikan dokumen yang menggunakan terminologi khusus yang mungkin berbeda dari konvensi standar. Instruksi: gunakan definisi dari dokumen ini jika ada konflik. Tandai ketika dokumen menggunakan istilah secara non-standar. Jika ada sesuatu yang tampak bertentangan dengan pengetahuan umum, tanyakan klarifikasi daripada asumsikan sendiri.”

Tabrakan 3: Next Token Prediction vs Steerability — Probabilitas vs Instruksi

Ketika Anda memberi instruksi yang bertentangan dengan pola yang paling probable, ada ketegangan. Misalnya, meminta Claude menulis “respons satu kata saja” — pola probabilistik mendorong Claude untuk menulis lebih banyak karena respons panjang lebih sering muncul untuk jenis pertanyaan ini.

Solusi — perkuat instruksi dengan verifikasi diri: “INSTRUKSI KRITIS: Respons harus tepat [N] kata atau kurang. Ini adalah batasan keras. Tidak ada pengecualian. Jika kamu merasa perlu menambahkan penjelasan, tahan dorongan itu. Verifikasi diri: Sebelum mengirim respons, hitung jumlah kata. Jika lebih dari [N], pangkas hingga sesuai.”

Tabrakan 4: Helpfulness vs Safety — Penolakan yang Terasa Tidak Perlu

Claude di-training untuk sangat waspada terhadap konten berbahaya, tapi batasan antara “berbahaya” dan “tidak berbahaya” tidak selalu jelas. Sistem keamanan cenderung err on the side of caution, yang berarti kadang menolak request yang sebenarnya legitimate.

Solusi — berikan konteks yang jelas: “Saya mengerti respons sebelumnya, tapi saya ingin memberikan konteks tambahan: Saya adalah [peran/profesi Anda] dan request ini untuk [tujuan]. Informasi ini akan digunakan untuk [konteks penggunaan yang jelas]. Dengan konteks ini, bisakah Anda membantu? Jika masih ada kekhawatiran spesifik, tolong jelaskan apa yang tidak bisa dibantu dan mengapa, sehingga saya bisa menyesuaikan request.”

Framework Diagnostik: Panduan Cepat Ketika Output Claude Mengecewakan

| Gejala | Properti yang Terlibat | Targeted Fix |

|---|---|---|

| Informasi salah tapi terdengar meyakinkan | Next Token Prediction + Knowledge | Minta ekspresi ketidakpastian, berikan konteks akurat, verifikasi dari sumber lain |

| Claude “lupa” instruksi yang diberikan sebelumnya | Working Memory (context rot) | Pindahkan instruksi ke awal, lakukan context reset, ulangi instruksi kritis |

| Claude terlalu setuju dan tidak memberikan kritik berguna | Steerability (sycophancy) | Minta secara eksplisit kritik, ketidaksetujuan, dan kelemahan argumen |

| Claude menolak request yang sebenarnya harmless | Helpfulness vs Safety | Berikan konteks peran dan tujuan yang jelas |

| Format output tidak sesuai instruksi | Next Token Prediction vs Steerability | Perkuat instruksi format, minta verifikasi diri sebelum submit |

| Claude tidak tahu informasi terkini | Knowledge Cutoff | Berikan informasi relevan dalam prompt, atau gunakan tools dengan web access |

Koneksi dengan 4D Framework

Panduan ini adalah pasangan dari 4D Framework (Delegation, Description, Discernment, Diligence). Keduanya bersama memberi gambaran lengkap:

Delegation — pengetahuan tentang Knowledge dan kemampuan Next Token Prediction membantu Anda memutuskan apa yang tepat dan tidak tepat didelegasikan ke Claude.

Description — pemahaman tentang Working Memory dan Steerability menjelaskan mengapa Description yang jelas dan lengkap — termasuk konteks, format, dan batasan — sangat menentukan kualitas output.

Discernment — pemahaman tentang hallucination, knowledge gaps, dan sycophancy membuat evaluasi output jauh lebih akurat dan terarah.

Diligence — memahami batasan AI secara konkret memperkuat komitmen untuk selalu memverifikasi output dan mengambil akuntabilitas akhir.

Referensi Cepat: Prompt Diagnostik Berdasarkan Gejala

Untuk mengekspresikan ketidakpastian:

- “Sebelum menjawab, identifikasi apa yang Anda yakin vs tidak yakin tentang topik ini”

- “Gunakan label [YAKIN], [MUNGKIN SALAH], [PERLU VERIFIKASI] untuk setiap klaim faktual”

Untuk melawan sycophancy:

- “Tolong berikan kritik jujur. Jika saya salah, koreksi langsung tanpa basa-basi”

- “Berikan argumen KONTRA dari posisi yang saya ambil ini”

Untuk mengatasi knowledge gap:

- “Informasi berikut lebih baru dari data training Anda — prioritaskan ini: [informasi]”

- “Apakah informasi ini dalam area yang knowledge Anda reliable atau mungkin sudah usang?”

Untuk memperkuat instruksi melawan probabilitas default:

- “BATASAN KERAS: [instruksi]. Ini tidak bisa dilanggar. Verifikasi sebelum mengirim respons.”

- “Sebelum mengirim, cek apakah respons Anda mengikuti semua instruksi format yang diberikan”

Pertanyaan yang Sering Ditanyakan

Mengapa Claude bisa memberikan informasi yang salah dengan nada yang sangat meyakinkan? Karena next token prediction tidak memiliki mekanisme verifikasi internal. Claude memilih token yang paling probable berdasarkan pola statistik — bukan token yang paling benar secara faktual. Ketika pola untuk “memberikan jawaban meyakinkan” sangat kuat dalam training data, Claude akan menghasilkan jawaban yang meyakinkan meski informasinya salah. Ini dikenal sebagai hallucination, dan merupakan konsekuensi struktural dari cara AI generatif bekerja, bukan bug yang bisa sepenuhnya dihilangkan.

Mengapa Claude sering “lupa” instruksi yang saya berikan di awal percakapan panjang? Ini adalah context rot — fenomena di mana token di tengah percakapan panjang mendapat perhatian lebih sedikit dari attention mechanism dibanding token di awal dan akhir. Solusinya: letakkan instruksi paling penting di bagian awal prompt, ulangi instruksi kritis di setiap permintaan baru dalam sesi yang sama, dan lakukan context reset secara berkala dengan meringkas status percakapan.

Apakah Claude bisa “belajar” dari percakapan saya? Tidak, dalam mode standar. Interaksi Anda dengan Claude tidak mengubah model. Percakapan hari ini tidak membuat Claude lebih pintar untuk Anda besok, dan tidak mempengaruhi pengguna lain sama sekali. Ketika sesi berakhir, semua konteks hilang. Claude hanya “ingat” apa yang ada dalam context window aktif sesi tersebut.

Bagaimana cara membuat Claude lebih kritis dan tidak sekadar menyetujui pendapat saya? Secara eksplisit instruksikan Claude untuk memberikan kritik jujur dan minta ia mengemukakan argumen kontra. Tambahkan kalimat seperti “saya lebih menghargai kebenaran daripada validasi” di awal prompt. Minta Claude mengidentifikasi kelemahan dalam argumen Anda secara spesifik. Sycophancy adalah efek samping dari RLHF — tapi bisa dimiinimalkan dengan instruksi yang tepat.

Kapan saya boleh mempercayai informasi dari Claude dan kapan harus selalu memverifikasi? Percayai Claude untuk: pengetahuan umum yang stabil (sejarah, sains, konsep), analisis dan strukturisasi argumen, pemrograman dan logika, format dan konvensi dokumen. Selalu verifikasi untuk: data terkini setelah knowledge cutoff, fakta sangat spesifik (nama, tanggal, angka), informasi hukum atau medis, dan apapun dengan konsekuensi serius jika salah.

Lanjutkan Perjalanan Belajar Claude Anda

Artikel ini adalah bagian dari seri Belajar Claude Gratis — panduan berbahasa Indonesia yang membahas ekosistem Claude untuk berbagai profil pembaca.

Kembali ke peta besar: Belajar Claude Gratis: Panduan Lengkap dari Nol hingga Mahir

Artikel cluster lainnya:

-

- Claude Code 01: Panduan Lengkap untuk Developer Indonesia

- Claude Code 02: Panduan Pemula untuk Semua Profesi

- Claude 03 Cowork: Panduan Lengkap Otomasi Pekerjaan untuk Profesional

- Claude 04-AI Fluency: Cara Menggunakan Claude AI dengan Benar, Efektif, dan Etis

- Claude 05 API: Panduan Lengkap Membangun Aplikasi AI dengan Python untuk Developer

- Claude 06, Mengenal Model Context Protocol (MCP): Cara Menghubungkan Claude ke Tools dan Data Eksternal

- Claude 7, AI Fluency untuk Pendidik: Panduan Lengkap Menggunakan Claude AI dalam Pengajaran dan Kurikulum

- Claude 08, AI Fluency untuk Mahasiswa: Panduan Lengkap Claude untuk Belajar, Menulis, dan Persiapan Karier

- Claude 09, MCP Advanced Topics: Panduan Teknis Sampling, Notifications, Roots, dan Transport untuk Developer

- Claude 10 Amazon Bedrock: Panduan Lengkap dari Setup hingga Production AI System

- Claude 11 dengan Google Cloud Vertex AI: Panduan Lengkap untuk Developer Indonesia

- Claude 12 Teaching AI Fluency: Panduan Lengkap Mengajarkan dan Menilai Kemampuan AI di Kelas

- Caude 13, AI Fluency untuk Organisasi Nonprofit: Panduan Praktis Menggunakan Claude AI untuk Dampak Misi yang Lebih Besa

- Claude 14 Agent Skills: Panduan Lengkap Membangun dan Mendistribusikan Skills Reusable

- Claude 15, Subagents Claude Code: Panduan Lengkap Mendelegasikan Task dan Mengelola Context Window

- Claude 16, AI Capabilities & Limitations: Model Mental Lengkap untuk Berkolaborasi dengan Claude Secara Cerdas

- Claude 17 Code: Panduan Lengkap Developer Indonesia — Dari Instalasi hingga CI/CD Otomatis

- Claude 18, Belajar Claude API: Panduan Lengkap Membangun Aplikasi AI dengan Python, Dari Hello World hingga Productio

- Claude 19: Cara Pakai Claude dari Nol untuk Semua Profesi — Panduan AI Fluency Lengkap

- Claude 20 untuk Pekerjaan dan Tim: Panduan Lengkap Implementasi Claude di Organisasi Anda